つまりなにしたの?

転移学習をすすめるにあたって、最後の層だけ学習して、それ以外の層はそのままにしたい。

1つの手としては、

model(inputs={'data': X}, outputs=['loss3/classifier'])

のoutputsを最終層の手前までにして事前にデータを変換してからそれに対して最終層を学習するモデルにする方法。

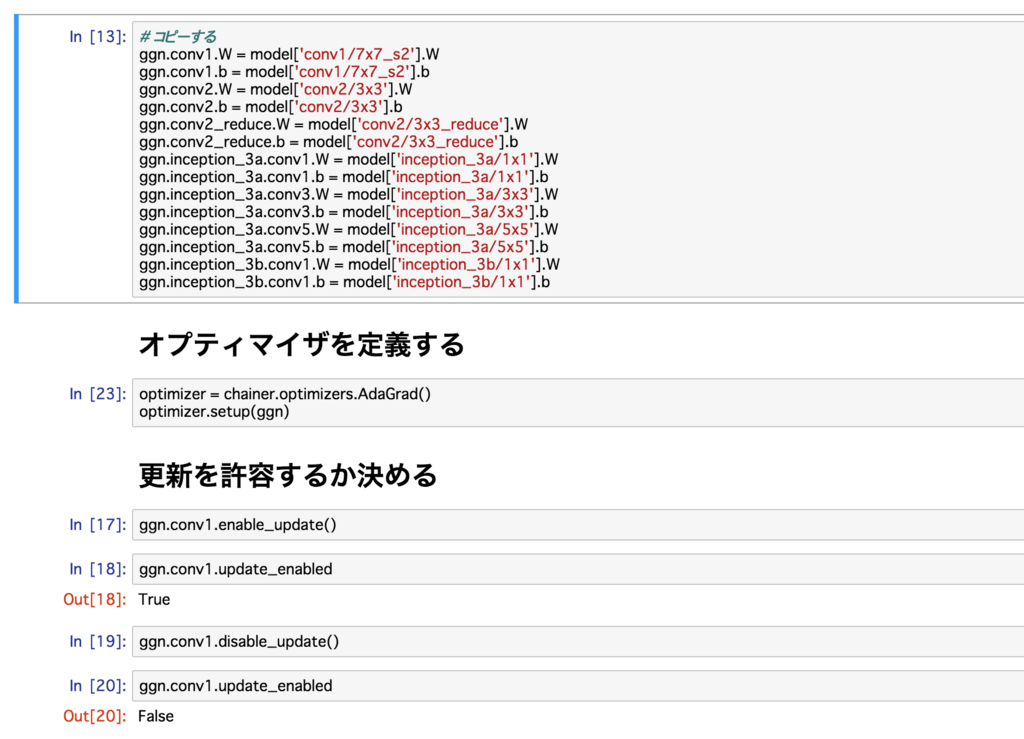

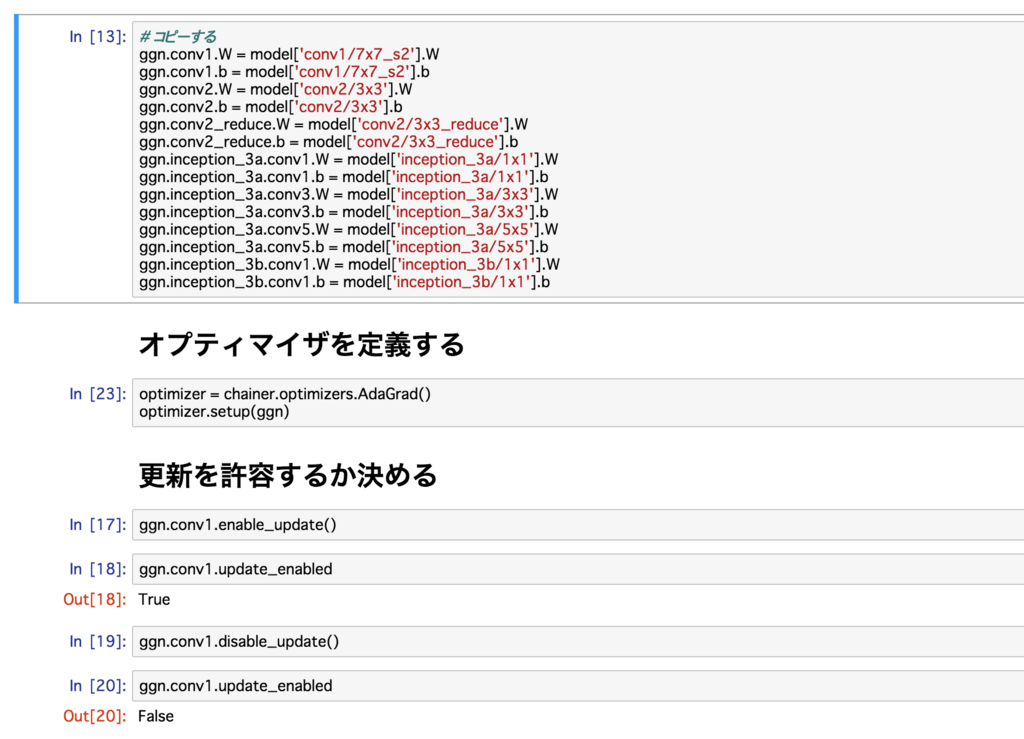

それとは別に、特定の層の最適化を行わない方法が検討できる。

今回は、特定の層の最適化を行わない方法をメモしておく。

転移学習をすすめるにあたって、最後の層だけ学習して、それ以外の層はそのままにしたい。

1つの手としては、

model(inputs={'data': X}, outputs=['loss3/classifier'])

のoutputsを最終層の手前までにして事前にデータを変換してからそれに対して最終層を学習するモデルにする方法。

それとは別に、特定の層の最適化を行わない方法が検討できる。

今回は、特定の層の最適化を行わない方法をメモしておく。

機械学習だディープラーニングだっ!と予測アルゴリズムを弄くりまわしたくなる気持ちをぐっと抑えて、

構築したアルゴリズムの予測結果を評価するための誤差(Error)の話。

ってことでデータ解析のコンテストとかでもよく使う誤差とその派生を幾つかまとめて、

すぐ使えるように式と Python (Numpy)コードで残しておくことにした。